En las entradas anteriores revisamos los conceptos de Nivel de Significación y Potencia en el contexto de los Contrastes de Hipótesis. Los contrastes estadísticos permiten concluir si se detectan o no diferencias en el grado de asociación entre variables o entre los valores medios de alguna variable bajo diferentes condiciones, al tiempo que se controlan las probabilidades de que las diferencias (detectadas o no se deban) a la variación aleatoria o fortuita. Esta píldora se centra en el denominado "Tamaño del Efecto".

El tamaño del efecto es una cuantificación de la magnitud o intensidad de una relación entre variables en una población, o el valor medio de alguna variable. Como una rama más de la familia los métodos estadísticos, cuantifica patrones de variación sistemática -asociados a condiciones especificables- de un fenómeno que presenta variación intrínseca. De ahí que las medidas del tamaño dependan en gran medida del modelo experimental, en tanto este influencie la variación observada:

- La naturaleza de la escala de medida de las variables está relacionada con la varianza y por tanto condiciona las medidas de tamaño del efecto aplicable a cada caso.

- Si mediante un diseño experimental concreto se consigue eliminar una parte de la variación de las comparaciones realizadas, ello también condiciona las medidas de efecto oportunas. Consideremos, por ejemplo, en eliminar la variación intra-individuos en un estudio de desgaste diferencial de 2 tipos de neumáticos que son calzados en los mismo vehículos, datos de panel, u otros diseños.

Existe una amplia variedad de medidas del tamaño del efecto que podemos agrupar en efectos basados en la varianza explicada, diferencia entre medias, y medidas para variables categóricas (en tablas de contingencia).

Los basados en la varianza explicada miden la proporción de la varianza de la variable respuesta explicada por el modelo experimental (en consonancia sobre lo explicado en la Píldora Estadística 1 sobre la media y la varianza). Entre ellos tenemos el coeficiente de determinación R-cuadrado que toma valores entre 0 y 1 (mínimo y máximo tamaño del efecto, respectivamente), el cuadrado del coeficiente de correlación lineal que (varia entre -1 y 1) midiendo no solo la intensidad sino también el sentido de la covariación , el llamado coeficente Eta-cuadrado (0,1 de interpretación análoga a R'cuadrado), una corrección al sesgo de ese último denominado Omega-cuadrado (0,1), Epsilon-cuadrado (a veces referido como R'cuadrado corregido), y Cohen f-cuadrado. Todos los anteriores son adimensionales. R-cuadrado se emplea cuando se regresa una variable de escala sobre otras variables de escala, los otros son propios del análisis de la varianza donde una variable de escala presenta un comportamiento medio diferentes en diferentes poblaciones especificadas mediante factores cualitativos.

Los basados en la diferencia entre medias, se obtienen por diferencia de medias de variables de escala entre los grupos considerados, si bien suelen estandarizarse dividiendo por la desviación típica para poner su valor en relación a la variabilidad de la población e interpretar su tamaño correctamente. d de Cohen, g de Hedges, delta de Glass (los valores de las medidas anteriores se pueden interpretar como puntuaciones de una variable z con distribución de probabilidades N(0,1).

Los específicos para variables categóricas dependen de la escala de las variables y el tamaño de las tablas de contingencia. En tablas 2*2 el Riesgo Relativo (cociente de probabilidades, que se recomienda evaluar conjuntamente con la Diferencia de Riesgo) y Odds Ratio (cociente de ventajas) que miden cuan relativamente más ventajosa; ambas son positivas aunque no acotadas. Para tablas mayores la medida Chi-cuadrado (con rango de valores no normalizado), V de Cramer (entre 0 y 1 de maxima asociación) y otras. En el caso de variables ordinales, la asociación se mide a través de la concordancia de las ordenaciones como, por ejemplo, Kappa de Cohen.

En lo que resta de esta píldora, vamos a recrear un ejemplo ficticio para realizar un análisis de la varianza (ANOVA) donde la media de una variable de escala que se distribuye normalmente, depende de los niveles de 2 factores binarios. El mecanismo de generación de datos nos permitirá una mejor comprensión de los conceptos revisados en esta serie de entradas del blog.

COMMENT las siguientes líneas de código, tras establecer la semilla para la pseudo-aleatorización que permite replicar los casos, generan 10k casos con 2 factores binarios (factor1 y factor2) y una variable respuesta (valor) . SET SEED=1234. INPUT PROGRAM. LOOP id=1 to 10000. COMPUTE factor1=RV.BERNOULLI(0.5). COMPUTE factor2=RV.BERNOULLI(0.5). COMPUTE valor=RV.NORMAL(100 + 20 * factor1 + 7 * factor2, 15). END CASE. END LOOP. END FILE. END INPUT PROGRAM. EXECUTE.

El código anterior crea 10.000 casos con 2 factores binarios (con frecuencia relativa de éxito 50% en ambos casos). Crea también una variable respuesta que se distribuye normalmente con desviación típica 15 y cuya media se obtiene aditivamente a partir de un valor base (100) al que se añaden 20 unidades en el caso de que el factor1 =1 y otras 7 unidades en el caso de que el factor2=1.

La ecuación de la media de la distribución (en la línea COMPUTE valor=RV.NORMAL("ecuación de la media", desviación típica = 15) en el bloque de código anterior) muestra que los efectos de los dos factores son aditivos e independientes: no hay interacción como sería el caso si se introduce un término adicional como "+ 2 * factor1 * factor2", que significaría que a la media de la distribución de la variable "valor" habría que sumar 2 unidades adicionales cuando ambos factores tomasen simultáneamente el valor 1. En las 3 combinaciones de ambos factores restantes [(0,0),(0,1) y (1,0)] la media quedaría inalterada.

Las unidades de medida de la variable "valor" no están especificadas, ni tampoco la naturaleza de los factores más allá de ser binarios. De hecho este modelo de generación de datos es equivalente a otro con un único factor con los 4 niveles resultantes de la combinación de los 2 factores anteriores.

Los coeficientes en la ecuación de la media de la distribución está elegidos de forma que los efectos de los factores (20 y 7) estén próximos a la desviación típica de la distribución (15 unidades). Al final de esta entrada, lo relacionaremos con los conceptos abordados en las píldoras anteriores de esta serie.

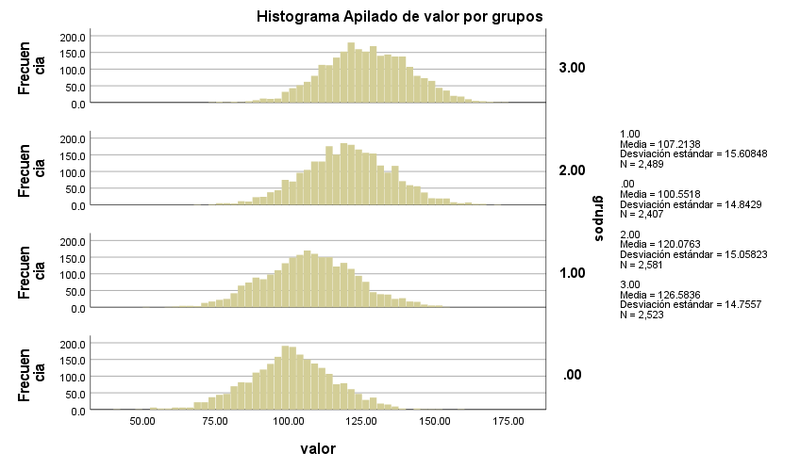

El gráfico siguiente muestra los histogramas de la variable valor para cada combinación de factores y la totalidad de los 10k casos que integran la población. Es evidente que los efectos poblaciones de los factores son relativamente pequeños, pues los histogramas se solapan. En otras palabras, cuando comparamos los 4 grupos apreciamos los efectos sistemáticos sobre la media, si bien están dentro del rango de variación normal de cualquiera de las 4 sub-poblaciones. En la leyenda se aprecia la constancia de la varianza y los diferentes valores medios de cada combinación de factores.

El bloque de código siguiente simula un muestreo sobre la población mediante la selección aleatoria de aproximadamente un 2% de los casos (Menú Datos>Seleccionar Casos). Con esto se pretende recrear las condiciones reales de investigación, donde las conclusiones se obtienen usualmente a partir de la observación de muestras representativas.

USE ALL. SET SEED=1234. COMPUTE filter_$=(uniform(1)<=.02). VARIABLE LABELS filter_$ 'Aproximadamente 2% de los casos (SAMPLE)'. FORMATS filter_$ (f1.0). FILTER BY filter_$. EXECUTE.

Vamos a realizar un Análisis de la Varianza de dos factores fijos con estimaciones de potencia y tamaño del efecto. En el Menú Principal Analizar>Modelo Lineal General>Univariado especificamos:

- En la ventana inicial trasladamos "valor" al recuadro de la variable independiente; factor1 y factor2 al recuadro de factores fijos (asumiendo así que todos los niveles de los factores están presentes)

- Ventana Modelo seleccionamos la opción"construir términos" , eligiendo el tipo "efectos principales" (sin interacción entre los factores) y trasladamos ambos factores al recuadro del modelo. Seleccionamos la opción "Incluir Intersección"

- Ventana Contrastes: seleccionamos el contraste diferencia para cada uno de los factores.

- Ventana Gráfico: trasladamos factor1 al recuadro del eje horizontal y pulsamos "añadir". Repetimos el procedimiento con el factor2. Seleccionamos incluid barras de error y línea de referencia para la media.

- Ventana Medias Marginales: trasladar OVERALL y ambos factores al recuadro de Mostrar Medias para. Seleccionar la opción de mostrar efectos principales.

- Ventana Opciones: seleccionar Estimación del Tamaño del Efecto y Potencia Observada.

Las especificaciones anteriores se recogen en le siguiente comando.

UNIANOVA valor BY factor1 factor2 /CONTRAST(factor1)=Difference /CONTRAST(factor2)=Difference /METHOD=SSTYPE(3) /INTERCEPT=INCLUDE /PLOT=PROFILE(factor1 factor2) TYPE=LINE ERRORBAR=CI MEANREFERENCE=YES YAXIS=AUTO /EMMEANS=TABLES(OVERALL) /EMMEANS=TABLES(factor1) COMPARE ADJ(LSD) /EMMEANS=TABLES(factor2) COMPARE ADJ(LSD) /PRINT ETASQ OPOWER /CRITERIA=ALPHA(.05) /DESIGN=factor1 factor2.

Los resultados del análisis se muestran a continuación

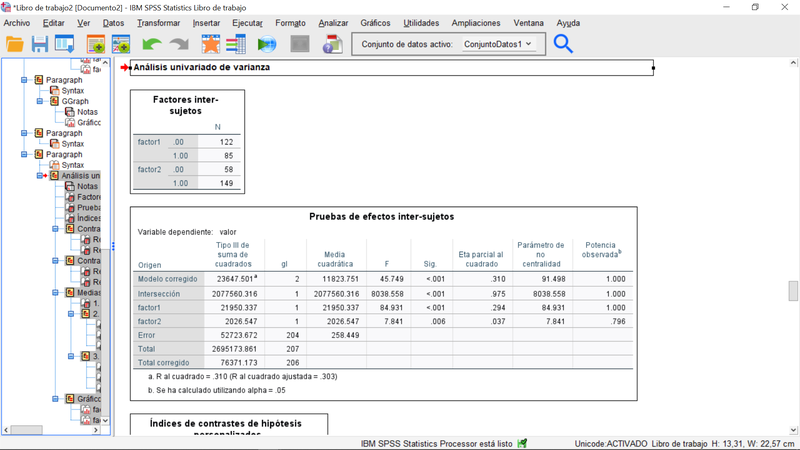

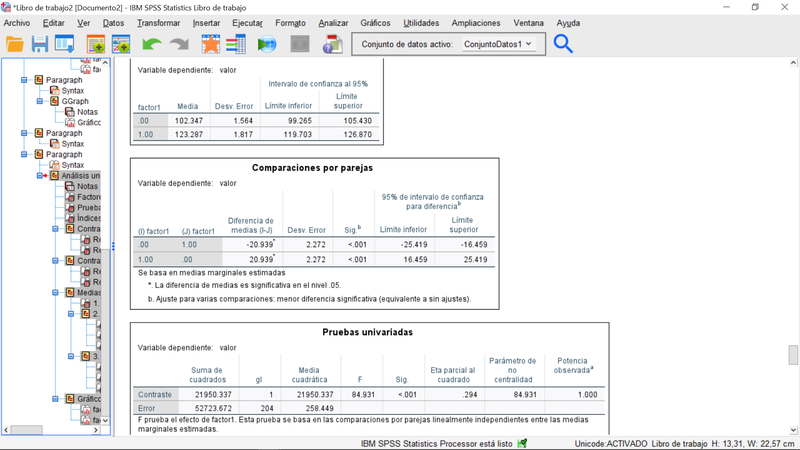

La medida del efecto, Eta-cuadrado nos informa de varios extremos:

- Globalmente, este modelo explica el 31% de la variación observada. Es decir, al dividir las observaciones en los 4 grupos resultantes de la combinación de factores, conseguimos reducir un 31% la varianza. Obsérvese que mientras el factor1 tiene un efecto de aproximadamente el 29%, el factor2 es considerablemente de menor tamaño (3%). Es preciso resaltar que el tamaño del efecto se mide como la reducción de la varianza como consecuencia de los factores y no como la diferencia de medias entre las distintas combinaciones de factores. El hecho de que sea un efecto moderado se debe a lo señalado anteriormente, la desviación típica de las observaciones (15) es relativamente grande cuando se compara con la variacion en la media como consecuencia de los factores 1 y 2 (20 y 7 respectivamente).

- La potencia estimada para detectar el efecto del factor2 es del 70% lo que deja una tasa de ERROR de tipo II (aceptar hipotesis falsa) del 30%.

- Ambos factores tienen efectos significativos sobre la media de la distribución.

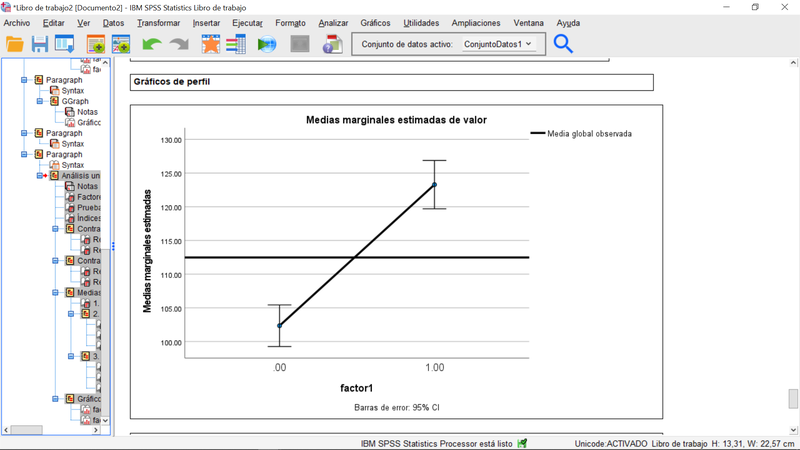

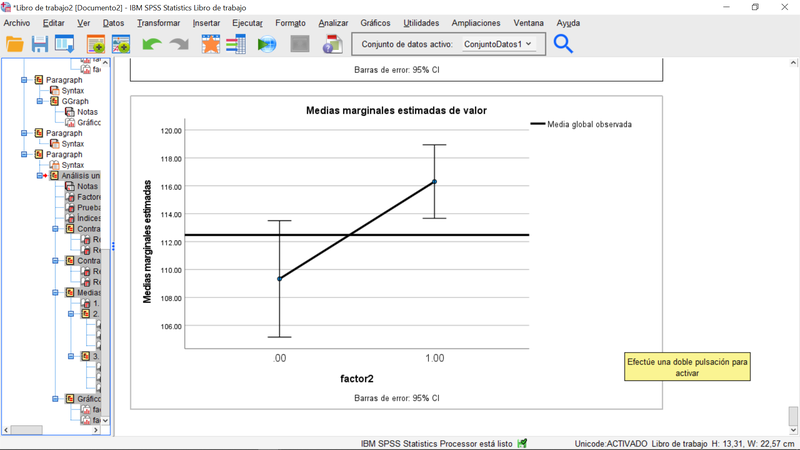

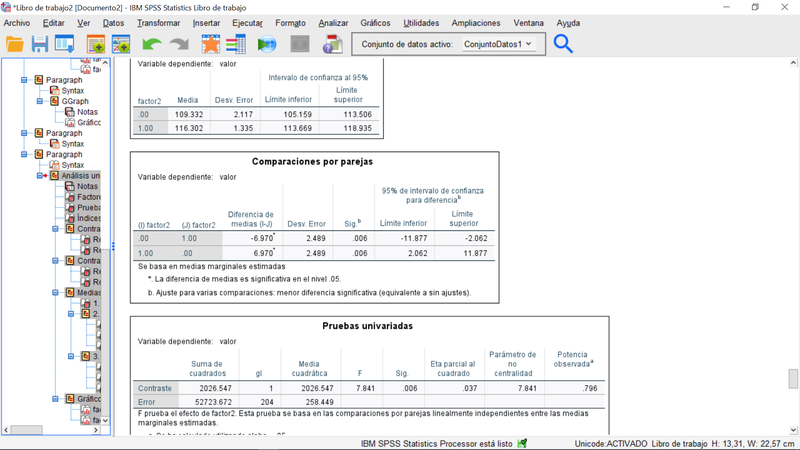

La medias marginales estimadas por el modelo para el factor2 muestras que en factor2=0, el intervalo de confianza alrededor de la media contiene a la media global.

La comparaciones por parejas para cada factor (abajo) muestran que la diferencia de medias entre los niveles 0 y 1 de cada factor han sido estimadas correctamente: 20,9 cuando el valor empleado para general los datos es 20 (factor1) y 6,9 en lugar de 7 (factor2).

El tamaño del efecto aparece nuevamente en los contrastes individuales como Eta-cuadrado.

Los bloques de código anterior nos permiten repetir todo el proceso de generación de datos-análisis introduciendo algunas alteraciones como las que que comentamos a continuación a título ilustrativo.

Si en la generación de datos aumentamos los efectos de los factores, subtituyendo la línea de código correspondiente por: COMPUTE valor=RV.NORMAL(100 + 55* factor1 + 30 * factor2, 6), es decir forzamos desviaciones de la media global más pronunciadas debido a los factores, el tamaño del efecto estimado mediate Eta-cuadrado aumenta hasta el 80% (el modelo explica hasta el 80%). La potencia observada para contrastar el efecto del factor2 aumenta hasta 1. Esto es consecuencia de que con los nuevos valores para los coeficientes de la ecuación de la media, hemos aumentado el efecto poblacional y lógicamente se detecta con mayor potencia y su tamaño estimado aumenta. Es decir, la variación residual del modelo (desviación típica 15) es relativamente menos importante relativamente a la contribución a la variación total atribuible a los factores.

Resultados análogos a los anteriores se obtienen si se reduce la desviación tipica en la ecuación de generación de valor desde 15 hasta, por ejemplo, 6: COMPUTE valor=RV.NORMAL(100 + 20 * factor1 + 7 * factor2, 15). Dejamos inalteradas los efectos sobre la media de la distribución debidos a los factores pero, al disminuir la variabilidad residual, conseguimos aumentar la estimación del tamaño del efecto.

Si con los datos originales aumentamos la proporción de casos muestreados por ejemplo, al 3% COMPUTE filter_$=(uniform(1)<=.03). la potencia observada para contrastar el efecto del factor2 aumentará, pues con mayor información es más probable detectar efectos presentes en la población.

La versión actual de IBM SPSS Statistics no incluye un procedimiento de Análisis de Potencia que permita calcular el tamaño muestral para un procedimiento ANOVA de dos factores. Aunque, por las características del ejemplo empleado podriamos emplear el procedimiento Análisis de Potencia para ANOVA univariante, la explicación detallada de las implicaciones, requiere un tratamiento específico que dejamos para otra pildora.